15/05/2024

W dzisiejszym świecie, gdzie dane są fundamentem podejmowania decyzji biznesowych, kluczowe staje się efektywne przetwarzanie i analiza informacji. Jednym z podejść, które zyskuje na popularności, jest proces ELT, czyli Ekstrakcja, Załadunek, Transformacja. Metoda ta, choć na pierwszy rzut oka podobna do tradycyjnego ETL, wprowadza istotne zmiany w kolejności operacji, co ma znaczący wpływ na sposób pracy z danymi. Zrozumienie procesu ELT jest niezbędne dla każdego, kto zajmuje się analizą danych, inżynierią danych czy architekturą systemów informatycznych.

Co to jest ELT?

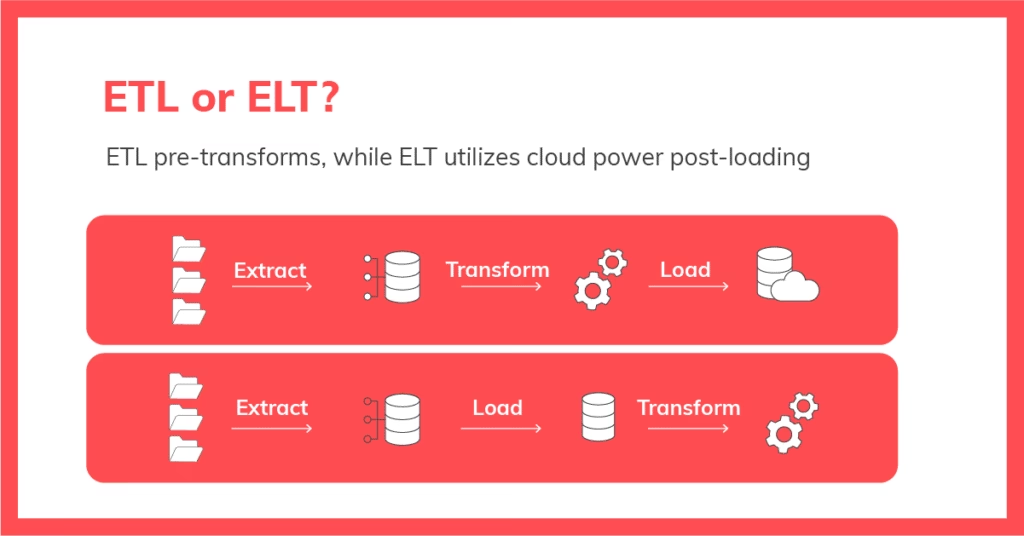

ELT to akronim od angielskich słów Extract, Load, Transform, co w języku polskim oznacza Ekstrakcja, Załadunek, Transformacja. Jest to proces integracji danych, który różni się od tradycyjnego podejścia ETL (Extract, Transform, Load) przede wszystkim kolejnością etapów. W metodzie ELT, dane są najpierw ekstrahowane z różnych źródeł, następnie ładowane bezpośrednio do docelowego magazynu danych, a dopiero na końcu poddawane transformacji. Kluczową różnicą jest więc przesunięcie etapu transformacji na czas po załadowaniu danych.

Tradycyjnie, w procesie ETL, dane były transformowane jeszcze przed załadowaniem do magazynu danych. ELT odwraca tę kolejność, co ma szereg konsekwencji. Głównym magazynem danych w podejściu ELT jest często data lake, czyli jezioro danych. Data lake to repozytorium przechowujące dane w ich surowej, nieprzetworzonej formie, zarówno dane strukturalne, jak i niestrukturalne. Dzięki temu ELT idealnie współgra z koncepcją data lake, umożliwiając przechowywanie ogromnych ilości danych różnego typu i formatu.

Data lakes są zazwyczaj zarządzane za pomocą platform big data, takich jak Apache Hadoop, lub rozproszonych systemów zarządzania bazami danych NoSQL. Ich głównym celem jest wspieranie analizy danych, w tym zaawansowanych technik, takich jak sztuczna inteligencja, uczenie maszynowe, analiza predykcyjna oraz aplikacje oparte na danych w czasie rzeczywistym i strumieniach zdarzeń. ELT, poprzez bezpośrednie ładowanie danych do data lake, stwarza idealne środowisko do tego typu zastosowań.

Kroki w procesie ELT

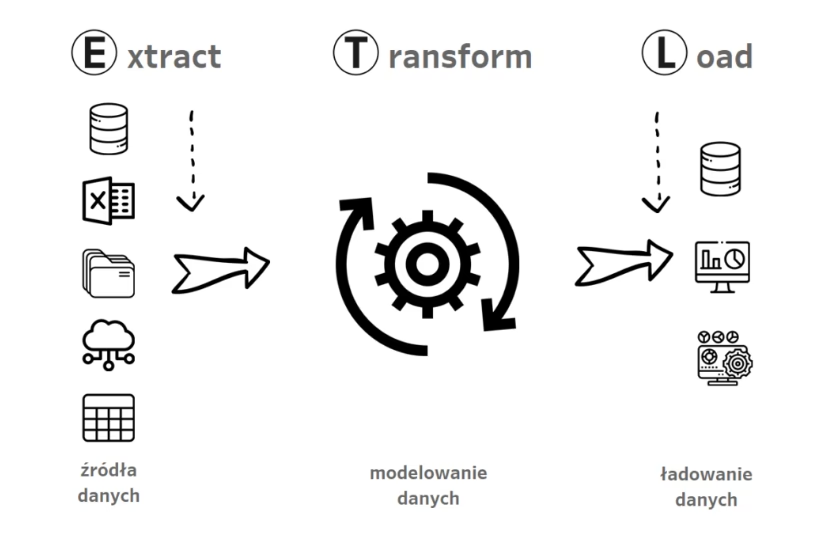

Proces ELT składa się z trzech kluczowych etapów:

1. Ekstrakcja (Extract)

Pierwszym krokiem w procesie ELT jest ekstrakcja danych. Polega ona na pobieraniu danych z różnorodnych źródeł. Źródła te mogą być bardzo zróżnicowane, obejmując:

- Bazy danych: Relacyjne bazy danych (np. SQL) i bazy NoSQL.

- Pliki: Pliki tekstowe (CSV, TXT), pliki JSON, XML, arkusze kalkulacyjne (np. Excel).

- Aplikacje SaaS (Software as a Service): Dane z platform chmurowych, takich jak Salesforce, Google Analytics, Marketo.

- Czujniki IoT (Internet of Things): Dane generowane przez urządzenia internetu rzeczy.

- Zdarzenia aplikacji: Logi aplikacji, dane telemetryczne.

Na etapie ekstrakcji zbierane są surowe dane w ich oryginalnym formacie. Mogą to być dane strukturalne (np. dane z baz danych), półstrukturalne (np. JSON, XML) lub niestrukturalne (np. tekst, obrazy, wideo). Ważne jest, aby na tym etapie skupić się na dokładnym i kompletnym pobraniu danych z wybranych źródeł.

2. Załadunek (Load)

Drugim krokiem jest załadunek danych. W procesie ELT, załadowanie danych odbywa się bezpośrednio do docelowego magazynu danych, którym najczęściej jest data lake. Kluczowe jest, że dane są ładowane w swojej surowej formie, bez wcześniejszej transformacji. Oznacza to, że dane są przenoszone z miejsc ich pochodzenia do data lake bez jakichkolwiek modyfikacji w trakcie transportu.

Załadunek danych powinien być przeprowadzony w sposób efektywny i skalowalny, szczególnie w przypadku dużych wolumenów danych. Często wykorzystuje się do tego narzędzia i technologie big data, które umożliwiają szybkie i niezawodne przesyłanie danych do data lake. Ważne jest również zapewnienie integralności danych podczas procesu załadunku, aby uniknąć utraty lub uszkodzenia informacji.

3. Transformacja (Transform)

Ostatnim etapem procesu ELT jest transformacja danych. W przeciwieństwie do ETL, transformacja w ELT odbywa się po załadowaniu danych do data lake. Dopiero w tym momencie dane są przetwarzane i dostosowywane do konkretnych potrzeb analitycznych i aplikacyjnych.

Transformacje mogą obejmować szereg operacji, takich jak:

- Zmiana typów i formatów danych: Konwersja danych do odpowiednich formatów (np. zmiana formatu daty, konwersja typów danych liczbowych).

- Czyszczenie danych: Usuwanie danych niekompletnych, niepoprawnych, niespójnych lub nieaktualnych.

- Deduplikacja danych: Usuwanie zduplikowanych rekordów.

- Standaryzacja danych: Ujednolicenie formatów danych, np. adresów, nazw.

- Agregacja danych: Sumowanie, średnia, grupowanie danych w celu uzyskania zbiorczych wskaźników.

- Wzbogacanie danych: Dodawanie nowych informacji do istniejących danych, np. poprzez łączenie z innymi zbiorami danych.

- Filtrowanie danych: Wybieranie tylko istotnych danych na podstawie określonych kryteriów.

Transformacje w ELT są zazwyczaj wykonywane na żądanie, w zależności od konkretnych potrzeb analitycznych. Oznacza to, że różne grupy użytkowników, np. data scientists, mogą przeprowadzać własne transformacje danych, dostosowane do specyficznych zadań. Dzięki temu ELT zapewnia dużą elastyczność i swobodę w pracy z danymi.

ELT vs ETL: Kluczowe różnice

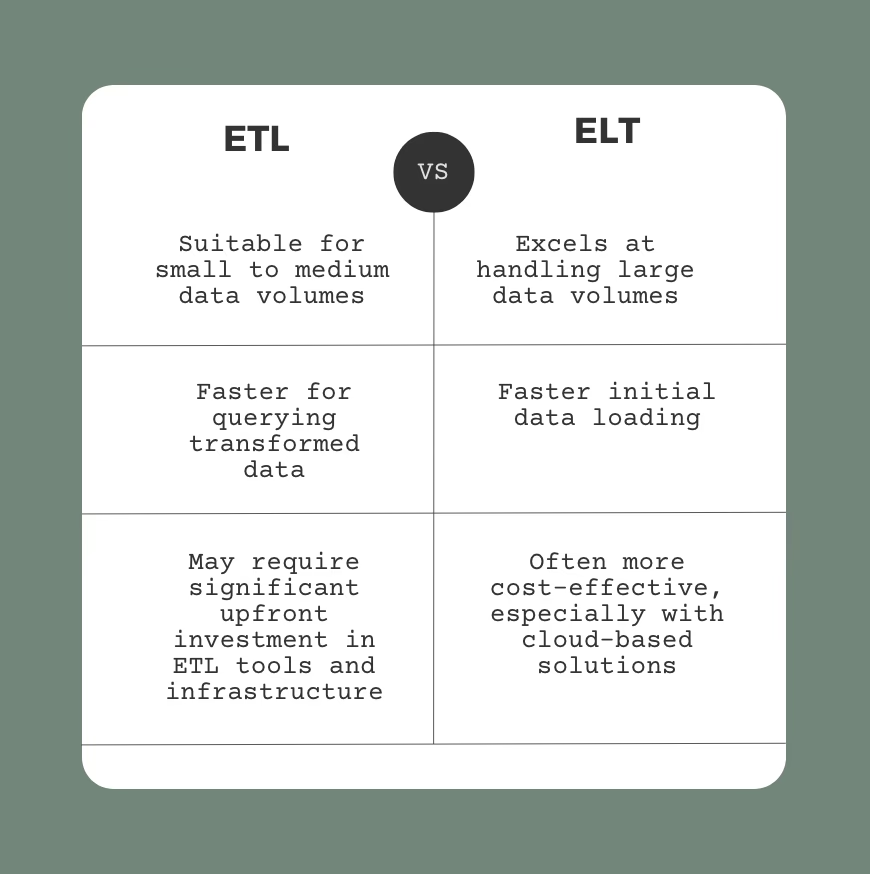

Choć zarówno ETL, jak i ELT mają na celu przygotowanie danych do analizy, istnieją kluczowe różnice między tymi podejściami:

| Cecha | ETL (Ekstrakcja, Transformacja, Załadunek) | ELT (Ekstrakcja, Załadunek, Transformacja) |

|---|---|---|

| Kolejność kroków | Transformacja przed załadunkiem | Załadunek przed transformacją |

| Docelowy magazyn danych | Tradycyjnie data warehouse (magazyn danych) | Często data lake (jezioro danych) |

| Transformacja danych w tranzycie | Tak | Nie |

| Zarządzanie danymi surowymi | Mniej problematyczne, dane transformowane przed załadowaniem | Wymaga odpowiedniego zarządzania danymi surowymi w data lake |

| Elastyczność transformacji | Mniejsza elastyczność, transformacje zdefiniowane z góry | Większa elastyczność, transformacje na żądanie, dostosowane do potrzeb |

| Zastosowanie | Tradycyjne business intelligence, raportowanie | Big data, analiza danych, sztuczna inteligencja, uczenie maszynowe |

Jedną z istotnych różnic jest wpływ na prywatność danych. W procesie ETL, transformacja danych przed załadowaniem może ułatwić implementację zasad ochrony danych, np. poprzez anonimizację lub maskowanie danych wrażliwych jeszcze przed ich umieszczeniem w magazynie danych. W ELT, dane surowe, w tym potencjalnie wrażliwe, trafiają najpierw do data lake, co wymaga szczególnej uwagi na kwestie bezpieczeństwa i zgodności z przepisami o ochronie danych, takimi jak RODO.

Z drugiej strony, data scientists często preferują ELT, ponieważ daje im dostęp do surowych danych, które mogą eksplorować i transformować w dowolny sposób, tworząc własne „piaskownice danych” (sandbox). Pozwala to na większą kreatywność i eksperymentowanie w procesie analizy danych.

Ostateczny wybór między ETL a ELT zależy od zasobów i potrzeb biznesowych. ETL może być bardziej odpowiedni w środowiskach, gdzie priorytetem jest ustrukturyzowane raportowanie i analizy, a bezpieczeństwo danych wymaga transformacji przed załadowaniem. ELT natomiast lepiej sprawdza się w środowiskach big data, gdzie liczy się skalowalność, elastyczność i możliwość przeprowadzania zaawansowanych analiz, w tym uczenia maszynowego.

Zalety i Wady ELT

Zalety ELT

- Szybkość załadunku danych: Brak transformacji w tranzycie przyspiesza proces załadunku danych do magazynu.

- Skalowalność: ELT dobrze współgra z data lakes i platformami big data, co umożliwia efektywne przetwarzanie ogromnych zbiorów danych.

- Elastyczność: Daje większą elastyczność w transformacji danych, umożliwiając transformacje na żądanie, dostosowane do konkretnych potrzeb.

- Dostęp do surowych danych: Data scientists mają dostęp do surowych danych, co umożliwia bardziej dogłębne analizy i eksperymentowanie.

- Wykorzystanie mocy obliczeniowej magazynu danych: Transformacje są wykonywane w magazynie danych, co wykorzystuje jego moc obliczeniową.

Wady ELT

- Zarządzanie danymi surowymi: Wymaga odpowiedniego zarządzania i zabezpieczenia danych surowych w data lake, w tym danych wrażliwych.

- Złożoność transformacji: Transformacje wykonywane w data lake mogą być bardziej złożone i wymagać specjalistycznej wiedzy i narzędzi big data.

- Wymagania dotyczące zasobów: Data lakes i platformy big data wymagają odpowiedniej infrastruktury i zasobów obliczeniowych.

- Potencjalne problemy z jakością danych: Jeśli transformacje nie są odpowiednio zaprojektowane, mogą wystąpić problemy z jakością danych analitycznych.

Kiedy stosować ELT?

Proces ELT jest szczególnie polecany w następujących sytuacjach:

- Big data: Gdy mamy do czynienia z bardzo dużymi ilościami danych, które trudno efektywnie przetwarzać w tradycyjnym ETL.

- Data lakes: Gdy docelowym magazynem danych jest data lake, przeznaczony do przechowywania danych surowych i różnorodnych.

- Zaawansowana analiza danych: Gdy celem jest zaawansowana analiza, sztuczna inteligencja, uczenie maszynowe, gdzie potrzebny jest dostęp do surowych danych i elastyczność transformacji.

- Szybkość wdrożenia: Gdy ważna jest szybkość załadunku danych i szybkie udostępnienie danych do analizy.

- Elastyczność transformacji: Gdy potrzebna jest duża elastyczność w transformacji danych, możliwość dostosowywania transformacji do różnych potrzeb i scenariuszy analitycznych.

Często Zadawane Pytania (FAQ)

Podsumowanie

Proces ELT stanowi nowoczesne podejście do integracji danych, które zyskuje na znaczeniu w erze big data i data lakes. Jego kluczową zaletą jest elastyczność i skalowalność, co czyni go idealnym rozwiązaniem dla zaawansowanych analiz danych, sztucznej inteligencji i uczenia maszynowego. Wybór między ELT a ETL powinien być podyktowany specyficznymi potrzebami biznesowymi, dostępnymi zasobami i charakterem danych, z którymi pracujemy. Zrozumienie różnic i zalet obu podejść pozwala na świadome i efektywne wykorzystanie potencjału danych w organizacji.

Jeśli chcesz poznać inne artykuły podobne do Proces ELT: Ekstrakcja, Załadunek, Transformacja Danych, możesz odwiedzić kategorię Rachunkowość.